Obiettivi | Certificazione | Contenuti | Tipologia | Prerequisiti | Durata e Frequenza | Docenti | Modalità di Iscrizione | Calendario

Il Corso DP-600 Fabric Analytics Engineer è pensato per partecipanti che devono implementare e gestire soluzioni di enterprise-scale data analytics usando Microsoft Fabric, trasformando dati grezzi in asset analitici governati e riutilizzabili come lakehouse, data warehouse e semantic models. Il percorso copre l’intero ciclo: discovery e accesso ai dati tramite OneLake catalog e Real-Time hub, scelta dell’architettura corretta (lakehouse/warehouse/eventhouse) e ingest tramite strumenti Fabric, fino alla trasformazione con approcci basati su SQL, Visual Query Editor e logiche di modellazione come star schema, denormalization, aggregations e join. Una parte rilevante è dedicata a security e governance: gestione di access controls a livello workspace e item, controlli granulari come row-level, column-level, object-level e file-level security, applicazione di sensitivity labels ed endorsement degli asset. Sul fronte delivery e lifecycle, i partecipanti lavorano su version control, Power BI Desktop project (.pbip), deployment pipelines, impact analysis delle dipendenze e deployment/management dei semantic models tramite XMLA endpoint. La sezione di semantic modeling entra nelle scelte di storage mode, relazioni avanzate (bridge tables, many-to-many), calcoli con DAX (variables, iterators, windowing, table filtering), calculation groups, dynamic format strings e field parameters, fino all’ottimizzazione su scala enterprise: tuning di performance, miglioramento DAX, configurazione Direct Lake (fallback e refresh behavior), scelta tra Direct Lake on OneLake vs SQL endpoints e incremental refresh. Il corso contribuisce alla preparazione dell’esame di Certificazione Fabric Analytics Engineer Associate.

Contattaci ora per ricevere tutti i dettagli e per richiedere, senza alcun impegno, di parlare direttamente con uno dei nostri Docenti (Clicca qui)

oppure chiamaci subito al nostro Numero Verde (800-177596).

Calling from abroad? Reach us at +39 02 87168254.

Obiettivi del corso

Di seguito una sintesi degli obiettivi principali del corso Corso Fabric Analytics Engineer DP-600:

- Implementare workspace e item governance: access controls, sensitivity labels, endorsement e secure sharing.

- Ingestire e preparare data in Fabric scegliendo correttamente tra lakehouse, warehouse ed eventhouse, usando OneLake catalog e Real-Time hub.

- Trasformare e modellare data con SQL e Visual Query Editor applicando star schema, join/merge, aggregations e data quality fixes.

- Progettare e costruire semantic models con relazioni avanzate e DAX per calcoli enterprise-ready.

- Ottimizzare semantic models con Direct Lake, incremental refresh e performance tuning su query e report visuals.

Certificazione del corso

Esame DP-600 Fabric Analytics Engineer Associate; Questo esame verifica le competenze del candidato nell’implementazione e gestione di una soluzione analitica end-to-end su Microsoft Fabric, con focus su governance, data preparation e semantic models. I topics testati includono Maintain a data analytics solution: implementazione di workspace-level e item-level access controls, controlli granulari row-level, column-level, object-level e file-level, applicazione di sensitivity labels ed endorsement degli item; gestione del development lifecycle con version control a livello workspace, creazione e gestione di Power BI Desktop project (.pbip), configurazione di deployment pipelines, impact analysis delle dipendenze downstream (da lakehouses, warehouses, dataflows e semantic models), deployment/management dei semantic models tramite XMLA endpoint e creazione/aggiornamento di asset riusabili (es. template e shared semantic models).

La sezione Prepare data copre creazione di data connections, discovery tramite OneLake catalog e Real-Time hub, ingestion/access ai dati e decisione tra lakehouse, warehouse ed eventhouse, inclusa OneLake integration per eventhouse e semantic models; trasformazioni come views/functions/stored procedures, enrichment con nuove columns/tables, star schema per lakehouse/warehouse, denormalization, aggregations, join/merge, gestione di duplicates/missing/nulls, conversione data types e filtering. Include anche query e analysis con Visual Query Editor, SQL, KQL e DAX.

Infine Implement and manage semantic models: scelta storage mode, star schema nel semantic model, relazioni avanzate (bridge e many-to-many), calcoli con DAX (variables, iterators, windowing, information functions), calculation groups, dynamic format strings e field parameters, large semantic model storage format e composite models; ottimizzazione con performance tuning, DAX optimization, configurazione Direct Lake (fallback/refresh), scelta Direct Lake on OneLake vs SQL endpoints e incremental refresh.

Contenuti del corso

Maintain a data analytics solution

- Workspace-level e item-level access controls, incl. row/column/object/file-level security

- Sensitivity labels ed endorsement per governance e trusted assets

- Version control per workspace e gestione Power BI Desktop project (.pbip)

- Deployment pipelines e release management tra ambienti

- Impact analysis e deployment semantic models via XMLA endpoint

Get data in Microsoft Fabric

- Create data connections e pattern di accesso ai dati

- Discovery con OneLake catalog e Real-Time hub

- Ingest o access data: scelte di ingestion strategy in base al workload

- Decisioning tra lakehouse, warehouse ed eventhouse

- OneLake integration per eventhouse e semantic models

Transform data for analytics

- Views, functions e stored procedures per shaping e reusable logic

- Enrichment: new columns/tables e business transformations

- Implementare star schema (lakehouse/warehouse) e denormalization patterns

- Aggregations, joins/merges e dataset consolidation

- Data quality: duplicates/missing/nulls, type conversion e filtering

Query and analyze data

- Visual Query Editor per selection/filtering/aggregation

- Querying con SQL per analytics workflows

- Querying con KQL per scenari event/real-time oriented

- Querying e analysis con DAX per semantic layer

- Scelte di tool e linguaggio in base a performance e maintainability

Design and build semantic models

- Storage mode selection e modeling strategy

- Star schema nel semantic model e relationship design (bridge, many-to-many)

- DAX calculations: variables, iterators, table filtering, windowing, information functions

- Calculation groups, dynamic format strings e field parameters

- Large semantic model storage format e composite models

Optimize enterprise-scale semantic models

- Performance improvements su queries e report visuals

- DAX performance tuning e best practices operative

- Direct Lake configuration: default fallback e refresh behavior

- Direct Lake on OneLake vs Direct Lake on SQL endpoints

- Incremental refresh strategy per semantic models

Tipologia

Corso di Formazione con Docente

Docenti

I docenti sono Istruttori Autorizzati Microsoft e in altre tecnologie IT, con anni di esperienza pratica nel settore e nella Formazione.

Infrastruttura laboratoriale

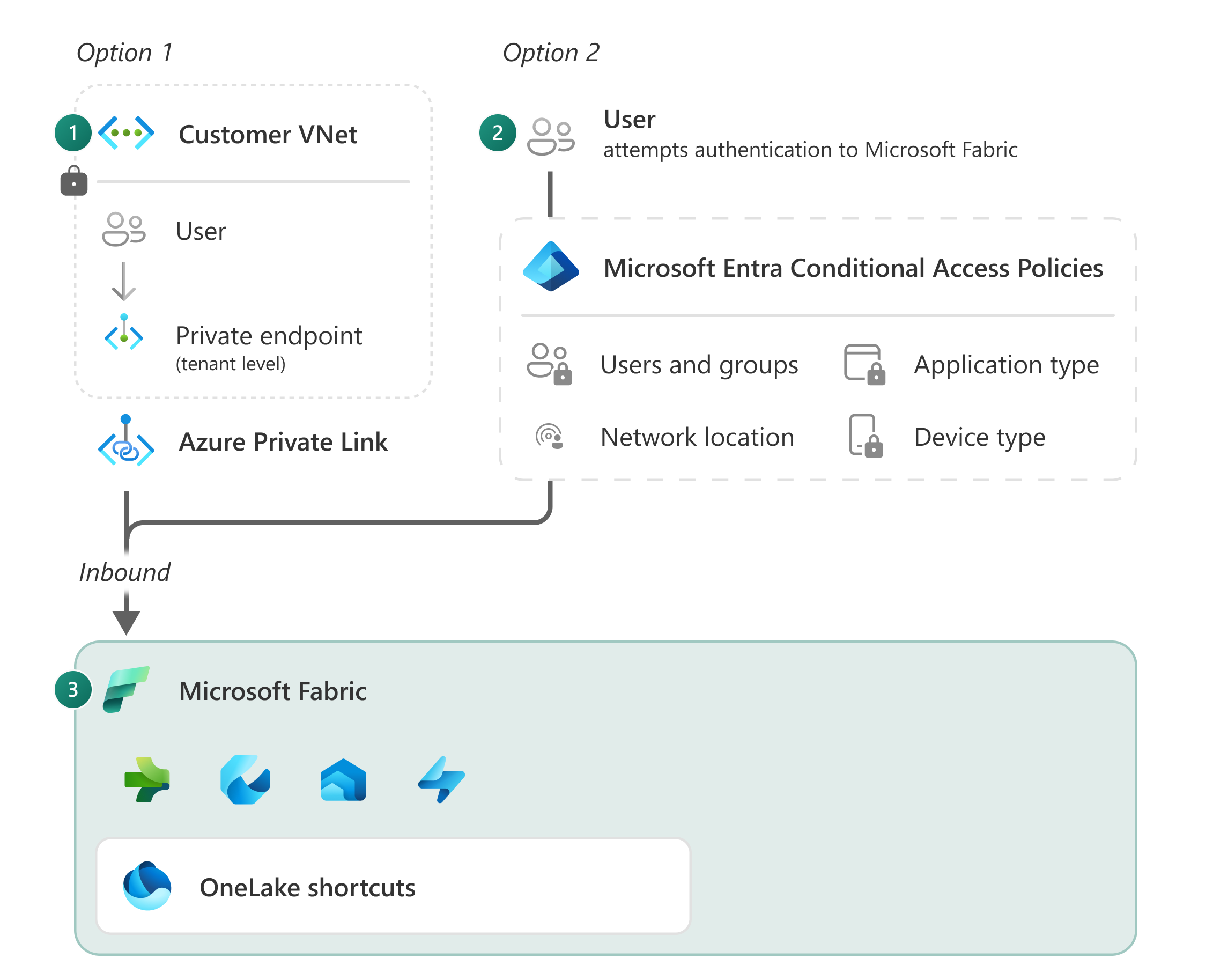

Per tutte le tipologie di erogazione, il Corsista può accedere alle attrezzature e ai sistemi presenti nei Nostri laboratori o direttamente presso i data center del Vendor o dei suoi provider autorizzati in modalità remota. Ogni partecipante dispone di un accesso per implementare le varie configurazioni avendo così un riscontro pratico e immediato della teoria affrontata. Ecco di seguito alcuni scenari tratti dalle attività laboratoriali:

Dettagli del corso

Prerequisiti

- Si consiglia la partecipazione al Corso Azure Data Fundamentals DP-900

Durata del corso

- Durata Intensiva 4gg;

Frequenza

Varie tipologie di Frequenza Estensiva ed Intensiva.

Date del corso

- Corso Fabric Analytics Engineer (Formula Intensiva) – Su richiesta – 09:00 – 17:00

Modalità di iscrizione

Le iscrizioni sono a numero chiuso per garantire ai tutti i partecipanti un servizio eccellente.

L’iscrizione avviene richiedendo di essere contattati dal seguente Link, o contattando la sede al numero verde 800-177596 o inviando una richiesta all’email [email protected].