Obiettivi | Certificazione | Contenuti | Tipologia | Prerequisiti | Durata e Frequenza | Docenti | Modalità di Iscrizione | Calendario

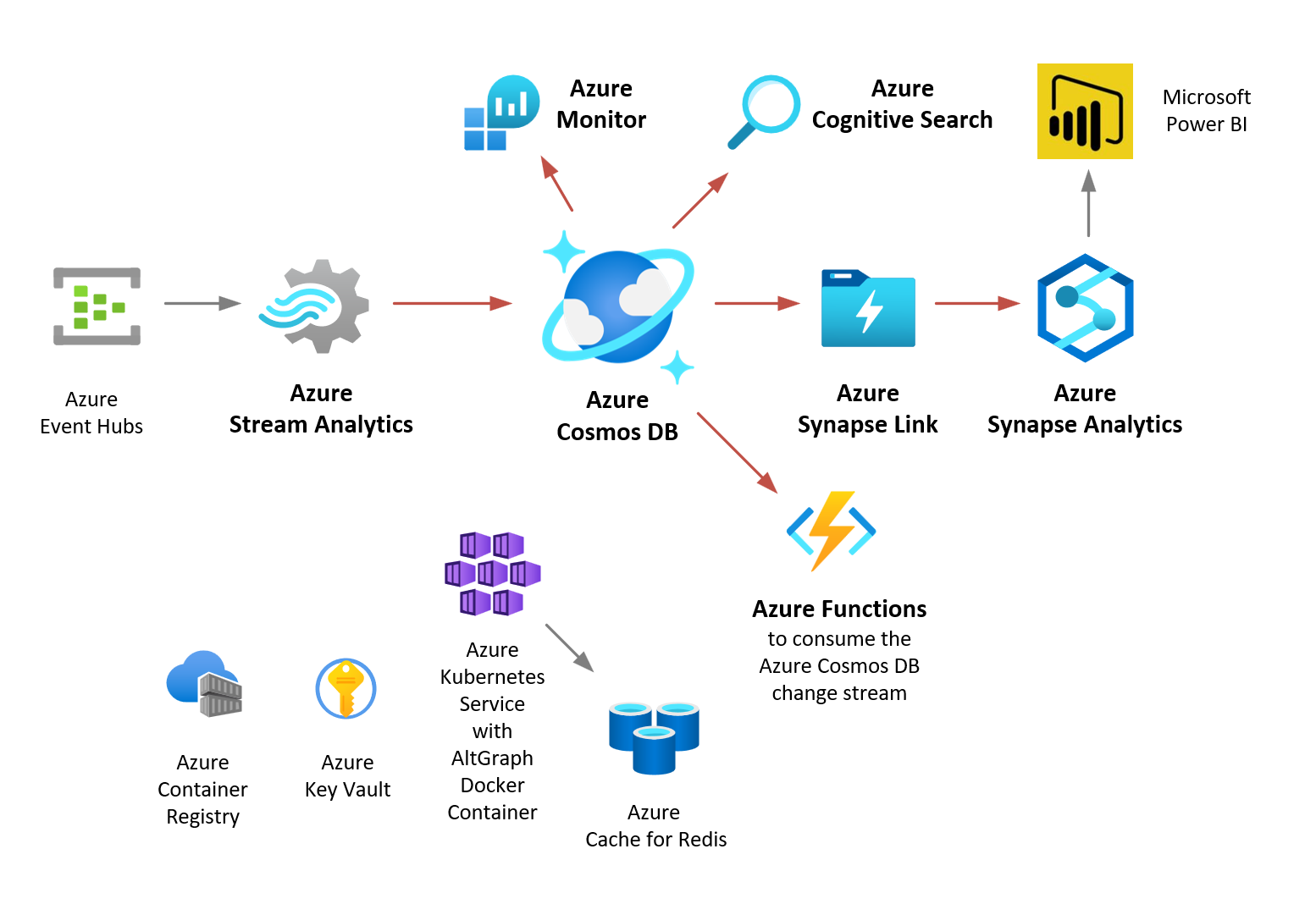

Il Corso DP-420 Azure Cosmos DB Developer (Design and implement cloud-native applications with Microsoft Azure Cosmos DB) è pensato per partecipanti che devono progettare e sviluppare applicazioni cloud-native basate su Azure Cosmos DB for NoSQL, usando NoSQL API e gli Azure Cosmos DB SDKs. Il corso porta a costruire un modello dati non-relazionale efficace, scegliendo la giusta strategia di partitioning (partition key, synthetic/hierarchical partition key) e impostando criteri di indexing coerenti con i pattern di accesso, con attenzione a performance e costi in Request Units (RU). Si lavora sull’accesso ai dati con query SQL (arrays, nested objects, aggregations, correlated subqueries) e sulle operazioni tipiche tramite SDK come point operations, query operations con pagination/continuation token, bulk support, transactional batch, optimistic concurrency con ETag, session consistency e gestione di errori temporanei e 429 throttling. Vengono trattati i principali aspetti di distribuzione e resilienza, includendo consistency models, global distribution, multi-region writes e conflict resolution. Il percorso affronta anche l’integrazione con servizi Azure per analytics e integrazioni event-driven: Azure Synapse Link (analytical store), connettore Spark, Azure Functions, Azure Event Hubs, e l’uso del change feed per denormalization, referential integrity, aggregation e archiving, oltre a scenari di ricerca con Azure AI Search. La parte operativa copre monitoring e troubleshooting con Azure Monitor, log/metrics, alerting, backup/restore (periodic/continuous), security e access control con Azure RBAC, Microsoft Entra ID, network access controls, encryption (incluse customer-managed keys con Azure Key Vault e Always Encrypted), CORS e data movement con Azure Data Factory, Azure Stream Analytics, Kafka connector e pipeline di ingestion. Il corso contribuisce alla preparazione dell’esame di Certificazione Azure Cosmos DB Developer Specialty.

Contattaci ora per ricevere tutti i dettagli e per richiedere, senza alcun impegno, di parlare direttamente con uno dei nostri Docenti (Clicca qui)

oppure chiamaci subito al nostro Numero Verde (800-177596).

Calling from abroad? Reach us at +39 02 87168254.

Obiettivi del corso

Di seguito una sintesi degli obiettivi principali del corso Corso Azure Cosmos DB Developer DP-420 (Design and implement cloud-native applications with Microsoft Azure Cosmos DB):

- Progettare data model NoSQL e partitioning strategy per workload cloud-native su Azure Cosmos DB for NoSQL.

- Implementare accesso ai dati con SQL query e SDK operations (bulk, transactional batch, concurrency, pagination).

- Definire indexing policies e ottimizzare query performance e RU consumption (incl. integrated cache).

- Integrare Cosmos DB con analytics ed event-driven patterns (Synapse Link, Spark, Functions, Event Hubs, change feed).

- Gestire monitoring, backup/restore, security, encryption e data movement con i principali servizi Azure.

Certificazione del corso

Esame DP-420 Azure Cosmos DB Developer Specialty; Questo esame valuta la preparazione del candidato sulla progettazione, implementazione e gestione di applicazioni cloud-native che utilizzano Azure Cosmos DB for NoSQL. I topics testati includono la capacità di definire un NoSQL data model scegliendo pattern come multiple entity types nello stesso container, entity co-location nello stesso document, denormalization e document references, oltre a chiavi primary/unique, access patterns e uso di TTL e versioning di document e schema. L’esame copre la scelta della partitioning strategy (partition key selection, synthetic/hierarchical partition key, planning delle transactions, cross-partition queries e valutazione della distribuzione di data e throughput) e il dimensionamento della soluzione (serverless vs provisioned, throughput a livello database, global distribution cost). Vengono verificate competenze su connectivity e client configuration negli SDK (gateway/direct mode, threading/parallelism, logging, region configuration, emulator) e sull’accesso ai dati con SQL query e SDK operations: point vs query operations, patch, transactional batch, bulk, ETag concurrency, session tokens, pagination/continuation token e gestione di transient faults e 429. Sono inclusi aspetti di replication e resilienza (consistency models, automatic/manual failover, multi-region writes e conflict resolution), integrazione analytics (Azure Synapse Link, analytical store, Spark/Synapse SQL) e integrazioni tra servizi (Functions/Event Hubs, change feed patterns, Azure AI Search). Completano l’esame monitoring e operations (Azure Monitor metrics/logs/alerts, normalized throughput/latency/partition distribution), backup/restore (periodic/continuous, point-in-time restore), security (RBAC, Microsoft Entra ID, network controls, encryption, Key Vault, CORS, Always Encrypted), data movement (ADF, Synapse pipelines, Kafka, Stream Analytics, Spark connector, IoT Hub custom endpoint) e DevOps/IaC (ARM templates, Azure CLI/PowerShell, indexing policy management, failover automation).

Contenuti del corso

Data modeling & partitioning for Cosmos DB for NoSQL

- NoSQL data modeling patterns (co-location, denormalization, document references, TTL, versioning)

- Partition key selection e workload-driven partitioning

- Synthetic/hierarchical partition key design e multi-partition workloads

- Throughput & storage sizing (serverless vs provisioned)

- Client connectivity choices (gateway/direct) e SDK configuration basics

Querying & SDK data access

- SQL query patterns (arrays, nested objects, aggregation, sorting, correlated subqueries)

- Point operations vs query operations (CRUD)

- Patch operations e optimistic concurrency con ETag

- Transactional batch, bulk support e retry strategy (incl. 429)

- Pagination e continuation token + query metrics usage

Global distribution, consistency & conflict resolution

- Consistency models e trade-off su latency/availability/cost

- Replication strategy e app connectivity to replicated data

- Automatic failover policy e manual failover operations

- Multi-region writes e conflict resolution policies

- Region-aware client settings per global workloads

Analytics & integrations across Azure services

- Azure Synapse Link e analytical store enablement

- Spark/Synapse SQL queries su analytical store e transactional store

- Change feed patterns con Azure Functions (denormalization, aggregation, archiving)

- Event-driven integrations con Azure Event Hubs e Functions

- Azure AI Search integration patterns per Cosmos DB data

Performance optimization & indexing

- Indexing strategy (read-heavy vs write-heavy) e index types

- Custom indexing policy configuration e composite index

- RU cost analysis e query cost evaluation

- Integrated cache design per read optimization

- Change feed scaling (change feed estimator) e processing tuning

Operations, security, data movement & DevOps

- Monitoring con Azure Monitor (throughput/latency/replication/partition distribution)

- Logs e alerting + troubleshooting via status codes e error metrics

- Backup/restore (periodic/continuous, point-in-time restore)

- Security & encryption (RBAC, Microsoft Entra ID, network controls, Key Vault, CMK, Always Encrypted, CORS)

- Data movement & automation (ADF/Synapse pipelines, Kafka, Stream Analytics, Spark connector, ARM templates, Azure CLI/PowerShell)

Tipologia

Corso di Formazione con Docente

Docenti

I docenti sono Istruttori Autorizzati Microsoft e in altre tecnologie IT, con anni di esperienza pratica nel settore e nella Formazione.

Infrastruttura laboratoriale

Per tutte le tipologie di erogazione, il Corsista può accedere alle attrezzature e ai sistemi presenti nei Nostri laboratori o direttamente presso i data center del Vendor o dei suoi provider autorizzati in modalità remota. Ogni partecipante dispone di un accesso per implementare le varie configurazioni avendo così un riscontro pratico e immediato della teoria affrontata. Ecco di seguito alcuni scenari tratti dalle attività laboratoriali:

Dettagli del corso

Prerequisiti

- Si consiglia la partecipazione al Corso Azure Data Fundamentals DP-900

Durata del corso

- Durata Intensiva 4gg;

Frequenza

Varie tipologie di Frequenza Estensiva ed Intensiva.

Date del corso

- Corso Azure Cosmos DB Developer (Formula Intensiva) – Su richiesta – 09:00 – 17:00

Modalità di iscrizione

Le iscrizioni sono a numero chiuso per garantire ai tutti i partecipanti un servizio eccellente.

L’iscrizione avviene richiedendo di essere contattati dal seguente Link, o contattando la sede al numero verde 800-177596 o inviando una richiesta all’email [email protected].