Obiettivi | Certificazione | Contenuti | Tipologia | Prerequisiti | Durata e Frequenza | Docenti | Modalità di Iscrizione | Calendario

Il Corso DP-203 Data Engineering on Microsoft Azure è un programma formativo che guida i partecipanti attraverso le competenze e le conoscenze necessarie per diventare ingegneri dei dati esperti nell’ecosistema Microsoft Azure. Il corso è progettato per insegnare ai partecipanti a progettare, costruire, gestire e proteggere le soluzioni di elaborazione dei dati su Azure.

Durante il corso, i partecipanti si concentreranno sull’utilizzo di vari servizi e tecnologie di Azure per creare e gestire soluzioni di ingegneria dei dati scalabili ed efficienti. Si impareranno a lavorare con Azure Data Factory, Azure Synapse Analytics, Azure Databricks e Azure Stream Analytics, tra gli altri servizi. Il corso copre anche la progettazione e l’implementazione di soluzioni di archiviazione dati, l’elaborazione dei dati in tempo reale e batch, e la gestione della sicurezza e conformità dei dati.

Le lezioni sono strutturate in modo da offrire un equilibrio tra teoria e pratica, consentendo ai partecipanti di comprendere i concetti chiave e applicare immediatamente le competenze acquisite attraverso esercitazioni e progetti. Questo approccio garantisce che i partecipanti abbiano una solida base teorica e una solida esperienza pratica nel lavorare con le soluzioni di ingegneria dei dati su Azure. Il corso contribuisce alla preparazione dell’esame di Certificazione Azure Data Engineer Associate.

Contattaci ora per ricevere tutti i dettagli e per richiedere, senza alcun impegno, di parlare direttamente con uno dei nostri Docenti (Clicca qui)

oppure chiamaci subito al nostro Numero Verde (800-177596).

Calling from abroad? Reach us at +39 02 87168254.

Obiettivi del corso

Di seguito una sintesi degli obiettivi principali del Corso Data Engineering on Microsoft Azure DP-203:

- Apprendere l’uso di servizi Azure per l’ingegneria dei dati.

- Progettare e gestire soluzioni di elaborazione dati.

- Lavorare con strumenti come Azure Data Factory e Azure Databricks.

- Gestire la sicurezza e conformità dei dati.

- Applicare le competenze acquisite attraverso esercitazioni e progetti.

Certificazione del corso

Esame DP-203 Azure Data Engineer Associate; Questo esame si concentra sulla valutazione delle competenze dei candidati nella progettazione e implementazione di soluzioni di ingegneria dei dati su Microsoft Azure. Testa la conoscenza nell’uso di strumenti come Azure Data Factory, Azure Synapse Analytics, Azure Databricks e Azure Stream Analytics. Si focalizza sull’elaborazione dei dati, sia in tempo reale che batch, sulla progettazione di soluzioni di archiviazione dati, e sulla gestione della sicurezza e conformità dei dati.

Contenuti del corso

Implement a partition strategy

- Implement a partition strategy for files

- Implement a partition strategy for analytical workloads

- Implement a partition strategy for streaming workloads

- Implement a partition strategy for Azure Synapse Analytics

- Identify when partitioning is needed in Azure Data Lake Storage Gen2

Design and implement the data exploration layer

- Create and execute queries by using a compute solution that leverages SQL serverless and Spark cluster

- Recommend and implement Azure Synapse Analytics database templates

- Push new or updated data lineage to Microsoft Purview

- Browse and search metadata in Microsoft Purview Data Catalog

Ingest and transform data

- Design and implement incremental loads

- Transform data by using Apache Spark

- Transform data by using Transact-SQL (T-SQL) in Azure Synapse Analytics

- Ingest and transform data by using Azure Synapse Pipelines or Azure Data Factory

- Transform data by using Azure Stream Analytics

- Cleanse data

- Handle duplicate data

- Avoiding duplicate data by using Azure Stream Analytics Exactly Once Delivery

- Handle missing data

- Handle late-arriving data

- Split data

- Shred JSON

- Encode and decode data

- Configure error handling for a transformation

- Normalize and denormalize data

- Perform data exploratory analysis

Develop a batch processing solution

- Develop batch processing solutions by using Azure Data Lake Storage, Azure Databricks, Azure Synapse Analytics, and Azure Data Factory

- Use PolyBase to load data to a SQL pool

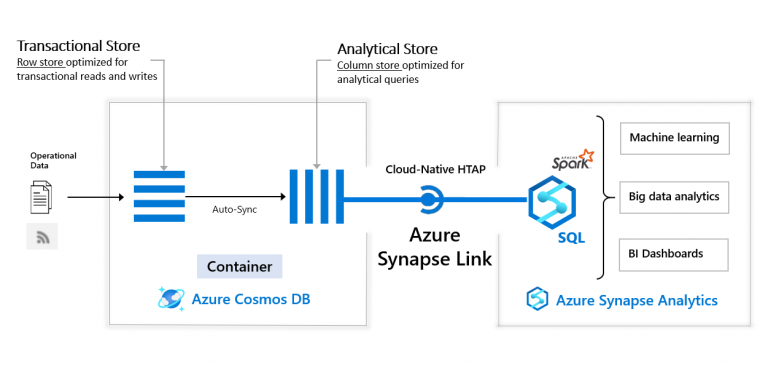

- Implement Azure Synapse Link and query the replicated data

- Create data pipelines

- Scale resources

- Configure the batch size

- Create tests for data pipelines

- Integrate Jupyter or Python notebooks into a data pipeline

- Upsert data

- Revert data to a previous state

- Configure exception handling

- Configure batch retention

- Read from and write to a delta lake

Develop a stream processing solution

- Create a stream processing solution by using Stream Analytics and Azure Event Hubs

- Process data by using Spark structured streaming

- Create windowed aggregates

- Handle schema drift

- Process time series data

- Process data across partitions

- Process within one partition

- Configure checkpoints and watermarking during processing

- Scale resources

- Create tests for data pipelines

- Optimize pipelines for analytical or transactional purposes

- Handle interruptions

- Configure exception handling

- Upsert data

- Replay archived stream data

Manage batches and pipelines

- Trigger batches

- Handle failed batch loads

- Validate batch loads

- Manage data pipelines in Azure Data Factory or Azure Synapse Pipelines

- Schedule data pipelines in Data Factory or Azure Synapse Pipelines

- Implement version control for pipeline artifacts

- Manage Spark jobs in a pipeline

Implement data security

- Implement data masking

- Encrypt data at rest and in motion

- Implement row-level and column-level security

- Implement Azure role-based access control (RBAC)

- Implement POSIX-like access control lists (ACLs) for Data Lake Storage Gen2

- Implement a data retention policy

- Implement secure endpoints (private and public)

- Implement resource tokens in Azure Databricks

- Load a DataFrame with sensitive information

- Write encrypted data to tables or Parquet files

- Manage sensitive information

Monitor data storage and data processing

- Implement logging used by Azure Monitor

- Configure monitoring services

- Monitor stream processing

- Measure performance of data movement

- Monitor and update statistics about data across a system

- Monitor data pipeline performance

- Measure query performance

- Schedule and monitor pipeline tests

- Interpret Azure Monitor metrics and logs

- Implement a pipeline alert strategy

Optimize and troubleshoot data storage and data processing

- Compact small files

- Handle skew in data

- Handle data spill

- Optimize resource management

- Tune queries by using indexers

- Tune queries by using cache

- Troubleshoot a failed Spark job

- Troubleshoot a failed pipeline run, including activities executed in external services

Tipologia

Corso di Formazione con Docente

Docenti

I docenti sono Istruttori Autorizzati Microsoft e in altre tecnologie IT, con anni di esperienza pratica nel settore e nella Formazione.

Infrastruttura laboratoriale

Per tutte le tipologie di erogazione, il Corsista può accedere alle attrezzature e ai sistemi presenti nei Nostri laboratori o direttamente presso i data center del Vendor o dei suoi provider autorizzati in modalità remota. Ogni partecipante dispone di un accesso per implementare le varie configurazioni avendo così un riscontro pratico e immediato della teoria affrontata. Ecco di seguito alcuni scenari tratti dalle attività laboratoriali:

Dettagli del corso

Prerequisiti

Si consiglia la partecipazione al Corso Azure Fundamentals e al Corso Azure Data Fundamentals.

Durata del corso

- Durata Intensiva 4gg;

Frequenza

Varie tipologie di Frequenza Estensiva ed Intensiva.

Date del corso

- Corso Data Engineering on Microsoft Azure (Formula Intensiva) – Su richiesta – 09:00 – 17:00

Modalità di iscrizione

Le iscrizioni sono a numero chiuso per garantire ai tutti i partecipanti un servizio eccellente.

L’iscrizione avviene richiedendo di essere contattati dal seguente Link, o contattando la sede al numero verde 800-177596 o inviando una richiesta all’email [email protected].